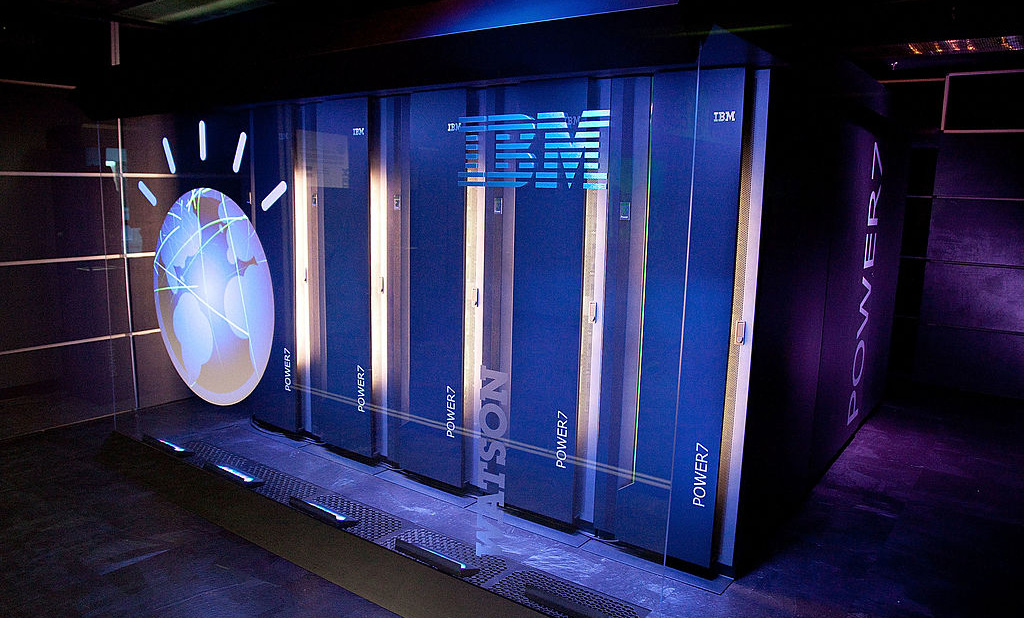

Der Supercomputer Watson des Tech-Giganten IBM erlangte 2011 Weltruhm, als er zur amerikanischen TV-Quizshow Jeopardy! gegen zwei Spitzenkandidaten gewonnen. IBM-Aktien schossen in die Höhe. CEO Ginni Rometty kündigte mutig an, dass Watson die Welt der Medizin, Finanzen und Spionage revolutionieren würde.

Kurz darauf wurde die Anwendung „Watson for Oncology“ eingeführt, die auf der Grundlage großer medizinischer Daten die beste Diagnose und den individuellsten Behandlungsplan für den Patienten erstellen sollte. Namhafte Kliniken wie das MD Anderson Center in Texas fielen auf die Geschichte herein und kauften das System für 62 Millionen Dollar. Die Medien spekulierten über das Ende der Ärzteschaft.

Bald darauf mussten die Ärzte jedoch feststellen, dass Watson mit falschen Behandlungsplänen aufwartete, die sogar das Leben der Patienten aufs Spiel setzten. Künstliche Intelligenz hat sich bei näherer Betrachtung als unfähig erwiesen, einen menschlichen Arzt zu ersetzen. Watsons Niveau war nicht höher als das eines Medizinstudenten im ersten Jahr.

Nach mehreren gescheiterten Versuchen, das System zu verbessern, wurde die Watson-Health-Sparte im Januar 2022 stillschweigend von IBM verkauft.

Gerd Gigerenzer untersucht die Entscheidungsfindung

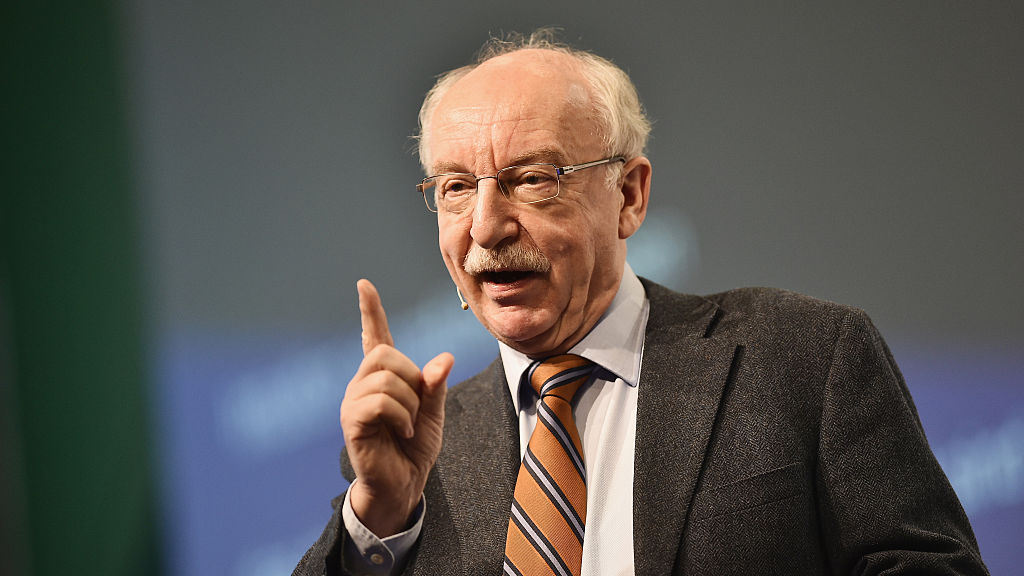

Diese Anekdote über die Tendenz der Menschen, künstliche Intelligenz fast übernatürliche Eigenschaften zuzuschreiben, stammt aus dem Buch Wie man in einer intelligenten Welt schlau bleibt: Warum menschliche Intelligenz immer Algorithmen schlägt des deutschen Psychologen Gerd Gigerenzer (1947).

Der Direktor des Harding-Zentrums für Riskokompetenz an der Universität Potsdam ist ehemaliger Direktor des Max-Planck-Instituts für Bildungsforschung in Potsdam und Professor für Psychologie an der University of Chicago. Er hat mehrere Bücher über Heuristik und Entscheidungsfindung für Manager geschrieben, darunter Adaptives Denken und Rationalität für Sterbliche.

Gigerenzer beschäftigt sich seit Jahrzehnten mit der Entscheidungsfindung unter unsicheren Umständen. Mit seinem neuesten Buch plädiert er nachdrücklich für die anhaltende Bedeutung des menschlichen Urteilsvermögens in einer automatisierten Welt.

Der Psychologe macht eine Stärken-Schwächen-Analyse des Gehirns und der schwindelerregenden Rechenleistung der künstlichen Intelligenz. „Gerade wegen technologischer Entwicklungen müssen wir mehr denn je unser Gehirn einsetzen.“

Bauen Sie ein allwissendes System auf

Das stille Verschwinden des Supercomputers Watson ist eine von vielen praktischen Situationen, in denen sich Gigerenzer fragt, ob der Einsatz künstlicher Intelligenz sinnvoll ist. „Als Führungskraft muss man wissen, ob das KI-System wirklich hält, was es verspricht, oder ob es nur ein gutes Marketing-Pitch ist.“

Laut dem Professor ist eines der großen Missverständnisse über künstliche Intelligenz, dass Algorithmus- und Deep-Learning-Entwickler an einem allwissenden System arbeiten. Dieses System wählt Ihren idealen Liebespartner aus oder plant, wann der richtige Zeitpunkt für Kinder ist. Oder ein Sozialarbeiter erhält per KI Signale und vereinbart einen Termin mit Ihrem Kind, bevor Sie wissen, dass es depressiv war.

Aber die KI kann nicht viel machen, sagt Gigerenzer. Er argumentiert, dass Sie verstehen müssen, wo sich Algorithmen auszeichnen und wo sie immer hinter der menschlichen Intelligenz zurückbleiben.

Wozu ist künstliche Intelligenz gut?

KI liefert die besten Ergebnisse in einer „stabilen Welt“, in der sich wenig ändert. „Komplexe Algorithmen funktionieren am besten in wohldefinierten und stabilen Situationen, in denen große Datenmengen verfügbar sind. Ein gut programmierter Schachcomputer wird daher immer den Großmeister schlagen.

Ganz anders ist es, wenn die Umstände ungewiss sind, wie auf der Straße, wo ein kleines Kind vielleicht einfach zwischen geparkten Autos hinausläuft. „Deshalb werden vollautonome Autos (Level 5) niemals in der Lage sein, in irgendeiner Umgebung ohne menschliche Aufsicht zu fahren, auch wenn Sie dieses Versprechen hören.“

In der Praxis bedeutet das, dass Watson in einer Spielshow überlegen ist, aber die Krebstherapie hat zu viele Unsicherheiten, wo ein Mensch bessere Entscheidungen trifft als ein Algorithmus, sagt der Professor. „Wenn die CEOs dieser Krankenhäuser das Prinzip einer stabilen Welt verstanden hätten, hätten sie niemals Millionen von Dollar in diese investiert.“

Die Maschine kann nicht kausal denken

Da die Technologie intelligenter wird, müssen auch die Menschen intelligenter werden. Dieses Grundwissen beinhaltet das Verständnis, was ein Computer leisten kann. „Das bedeutet blitzschnelle Berechnungen, das Finden von Zusammenhängen in Big Data und das Erkennen von Mustern in Bildern oder akustischen Informationen.“

In allen drei Bereichen wird der Computer immer besser, vor allem wenn sich die Rechengeschwindigkeit alle paar Jahre verdoppelt. „Aber im Moment ist eine Maschine nicht in der Lage, zum Beispiel kausales Denken, intuitive Psychologie, Verständnis von Raum und Zeit und Bewusstsein auf ein Softwaresystem zu kopieren.“

Gigerenzer ruft ihn an gesunder Menschenverstand, die Summe des geteilten Wissens, das ein Kind erlernt. „Das können wir einem Computer nicht beibringen, schon gar nicht durch Deep Learning. Denn es funktioniert nur in einer stabilen Umgebung.

Menschen in dem einsetzen, was sie am besten können

Wenn also ein Großmeister gegen einen Schachcomputer verliert, macht sich Gigerenzer keine Sorgen darüber, dass Algorithmen die Welt von den Menschen übernehmen.

„Unser Gehirn hat sich über Millionen von Jahren entwickelt und kann sehr gut mit Unsicherheiten umgehen, egal ob viele oder wenige Informationen verfügbar sind. Wir wissen nicht, wie Sie das in einen Computer bekommen. Beispielsweise hat ein Schachcomputer keine Ahnung, dass er Schach spielt.

Sich der Stärken und Schwächen von Menschen und Computern bewusst zu werden, ist für Gigerenzer der erste Schritt zu smarteren Abläufen in einer Welt, in der alles „intelligent“ wird. „Wir müssen künstliche Intelligenz das tun lassen, was sie am besten kann, und Menschen dafür einsetzen, das zu tun, was wir am besten können.“

Ein Computer kann unsere Kinder nicht erziehen, die Liebe unseres Lebens nicht finden und die Weltmacht nicht übernehmen, sagt er. „In unsicheren Situationen braucht man sowohl menschliches Urteilsvermögen als auch Transparenz.“

Transparente Algorithmen verhindern die Entstehung von Mythen

Das Buch ist voll von Beispielen dafür, wie allzu komplexe Algorithmen zur Entstehung von Mythen über die Überlegenheit künstlicher Intelligenz beitragen. Und dass die Menschen, sobald sie es nicht mehr verstehen, der künstlichen Intelligenz geradezu Übermacht zuschreiben.

Dies kann vermieden werden, indem die Algorithmen einfach und transparent gehalten werden, sagt Gigerenzer. „Zahlreiche Studien zeigen, dass einfache Algorithmen, bei denen wir genau verstehen, was sie messen, mindestens so effizient sind wie Systeme aus Millionen von Datenpunkten. Mehr Daten bedeuten nicht zwangsläufig bessere Ergebnisse. Erklären Sie genau, was Sie messen.

Als Berater der Bundesregierung versucht er, Politiker aufzurütteln, damit auch die Menschen klüger werden. Gleiches gilt für Journalisten. Jüngste Untersuchungen in Großbritannien zeigen, dass die Medien in 60 % der Fälle die Werbeaussagen der Hersteller pflichtbewusst fast blind wiederholen. „Ich sehe einen ähnlichen Trend in anderen Ländern.“

Der Watson-Computer von IBM sei ein gutes Beispiel, sagt er. „In allen Medien war zu lesen, dass Watson eine medizinische Revolution auslösen würde. Dass es nicht lange dauern würde, bis die Ärzte ihre Jobs verlieren würden. Sie haben an weit weniger Stellen gelesen, dass Watson jetzt verkauft wurde.

Menschliche und künstliche Intelligenz im Gleichgewicht

Gigerenzer interessiert die Frage, wie künstliche Intelligenz und Mensch eine bessere Balance finden können. Deshalb entwickelt er in Zusammenarbeit mit der Stanford University eine Methode, um jungen Menschen zu helfen Digital Natives Erfahren Sie, wie Sie Technologie besser verwalten können. „Wie analysiert man also eine Website, wie unterscheidet man Fakten von Fake News?“

In seinem Kampf für mehr Transparenz in der digitalen Welt sieht er die Akzeptanz von Cookies auf einer Website als Beispiel für einen Schritt in die richtige Richtung. Aber man muss es richtig machen, sagt er. „Also überladen Sie Ihren Besucher nicht mit einem langen Text und dem ‚Akzeptieren‘-Button, sondern mit klaren Optionen, bei denen Sie für jedes Element angeben können, was Sie akzeptieren und was Sie nicht akzeptieren.“

Die Balance zwischen Mensch und „intelligenter“ Welt sei Vertrauenssache, so der Psychologe. „Das Internet sollte einst das Tor zum Informationszeitalter sein, jetzt leben wir in einem Zeitalter der Information und Desinformation.

Gerd Gigerenzer sieht in diesen Fehlinformationen eine Bedrohung für die menschliche Evolution, weil sie unser Vertrauen in die Institutionen untergräbt, die für eine bessere Gesellschaft gebaut werden. Denken Sie an Regierung, Wissenschaft, investigativen Journalismus und Justiz. „Wir müssen das Internet reparieren. Das bedeutet zum Beispiel, dass wir überwachungsbasierten Erlösmodellen ein Ende setzen müssen. Wir müssen an digitaler Technologie arbeiten, auf die wir uns verlassen können, weil wir sie bekommen.

Erfahren Sie mehr über künstliche Intelligenz:

„Preisgekrönter Organisator. Social-Media-Enthusiast. TV-Fan. Amateur-Internet-Evangelist. Kaffee-Fan.“